ニュースリリース

リコー、モデルマージによってGPT-4と同等の高性能な日本語LLM(700億パラメータ)を開発

~お客様のオンプレミス環境でのプライベートLLM導入を加速~

- 2024年9月30日

- 株式会社リコー

株式会社リコー(社長執行役員:大山 晃)は、米Meta Platforms社が提供する「Meta-Llama-3-70B」の日本語性能を向上させた「Llama-3-Swallow-70B*1」をベースモデルに、同社のInstructモデルからベクトル抽出したChat Vector*2とリコー製のChat Vector*3をリコー独自のノウハウでマージすることで、高性能な日本語大規模言語モデル(LLM*4)を新たに開発しました。これにより、リコーが開発・提供するLLMのラインナップに、米OpenAIが開発したGPT-4と同等レベルの高性能モデルが追加されました。

生成AIの広がりにより、企業が業務で活用できる高性能なLLMのニーズが高まっています。しかし、LLMの追加学習は、コストが高く、時間もかかるという課題があります。その課題に対して、複数のモデルを組み合わせて、より高性能なモデルをつくる「モデルマージ*5」は効率的な開発手法として注目されています。

リコーは、モデルマージのノウハウと、LLM開発の知見に基づき、今回、新たなLLMを開発しました。本技術は、企業独自のプライベートLLMや特定業務向けの高性能なLLMの開発の効率化につながるものです。

リコーは、自社製LLMの開発だけではなく、お客様の用途や環境に合わせて、最適なLLMを低コスト・短納期でご提供するために、多様で効率的な手法・技術の研究開発を推進してまいります。

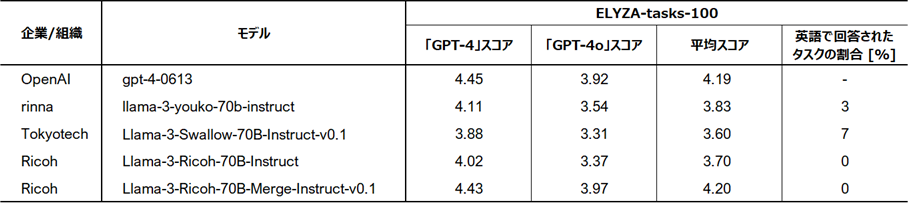

評価結果*6(ELYZA-tasks-100)

複雑な指示・タスクを含む代表的な日本語のベンチマーク「ELYZA-tasks-100」において、今回リコーがモデルマージの手法で開発したLLMはGPT-4と同等レベルの高いスコアを示しました。また、比較した他のLLMはタスクによって英語で回答するケースが見られましたが、全てのタスクに対して日本語で回答して高い安定性を示しました。

リコーのLLM開発の背景

労働人口減少や高齢化を背景に、AIを活用した生産性向上や付加価値の高い働き方が企業成長の課題となっており、その課題解決の手段として、多くの企業がAIの業務活用に注目しています。しかし、AIを実際の業務に適用するためには、企業固有の用語や言い回しなどを含む大量のテキストデータをLLMに学習させ、その企業独自のAIモデル(プライベートLLM)を作成する必要があります。

リコーは国内でもトップクラスのLLMの開発・学習技術をベースに、企業向けプライベートLLMの提供や、社内文書の活用を後押しするRAGの導入支援等、様々なAIソリューションの提案が可能です。

- *1

- Llama-3-Swallow-70B:東京工業大学情報理工学院 情報工学系の岡崎直観教授と横田理央教授らの研究チームと国立研究開発法人 産業技術総合研究所によって開発された日本語LLMモデル。

- *2

- Chat Vector:指示追従能力を持つモデルからベースモデルのウェイトを差し引き、指示追従能力のみを抽出したベクトル。

- *3

- リコー製のChat Vector:Meta社のベースモデル「Meta-Llama-3-70B」に対し、リコー独自開発を含む約1万6千件のインストラクションチューニングデータで追加学習したInstructモデルから抽出したChat Vector。

- *4

- Large Language Model(大規模言語モデル):人間が話したり書いたりする言葉(自然言語)に存在する曖昧性やゆらぎを、文章の中で離れた単語間の関係までを把握し「文脈」を考慮した処理を可能にしているのが特徴。「自然文の質問への回答」や「文書の要約」といった処理を人間並みの精度で実行でき、学習も容易にできる技術。

- *5

- モデルマージ:複数の学習済みのLLMモデルを組み合わせて、より性能の高いモデルを作る新たな方法のこと。GPUのような大規模な計算リソースが不要で、より手軽にモデル開発ができるとして、近年注目されています。

- *6

- 2024年9月24日時点の評価結果。「スコア」の算出に際して、生成文の評価には「GPT-4」(gpt-4-0613)と「GPT-4o」(gpt-4o-2024-05-13)を使用し、英語での回答による減点は行っていない。「英語で回答されたタスクの割合」は100タスクのうち英語で回答されたものの割合。

このニュースリリースはPDFファイルでもご覧いただけます

- ※

- 社名、製品名は、各社の商標または登録商標です。

| リコーグループについて |

リコーグループは、お客様のDXを支援し、そのビジネスを成功に導くデジタルサービス、印刷および画像ソリューションなどを世界約200の国と地域で提供しています(2024年3月期グループ連結売上高2兆3,489億円)。

“はたらく”に歓びを 創業以来85年以上にわたり、お客様の“はたらく”に寄り添ってきた私たちは、これからもリーディングカンパニーとして、“はたらく”の未来を想像し、ワークプレイスの変革を通じて、人ならではの創造力の発揮を支え、さらには持続可能な社会の実現に貢献してまいります。

詳しい情報は、こちらをご覧ください。

https://jp.ricoh.com/

このページの内容は発表時のものです。

既に販売終了になっている商品や、内容が異なっている場合があります。